Synteza jądrowa fascynuje fizyków, inżynierów i filozofów nauki, bo łączy w sobie najgłębsze pytania o naturę materii z bardzo praktyczną wizją niemal niewyczerpalnego źródła energii. To właśnie dzięki niej świecą gwiazdy, a w ich wnętrzach powstają pierwiastki budujące nasze ciała, planety i całe galaktyki. Zrozumienie mechanizmów syntezy jądrowej wymaga sięgnięcia do fizyki jądrowej, termodynamiki, fizyki plazmy i technologii materiałowej, ale jednocześnie pokazuje, jak ściśle teoria spotyka się z inżynierią i globalną polityką energetyczną.

Podstawy fizyki syntezy jądrowej

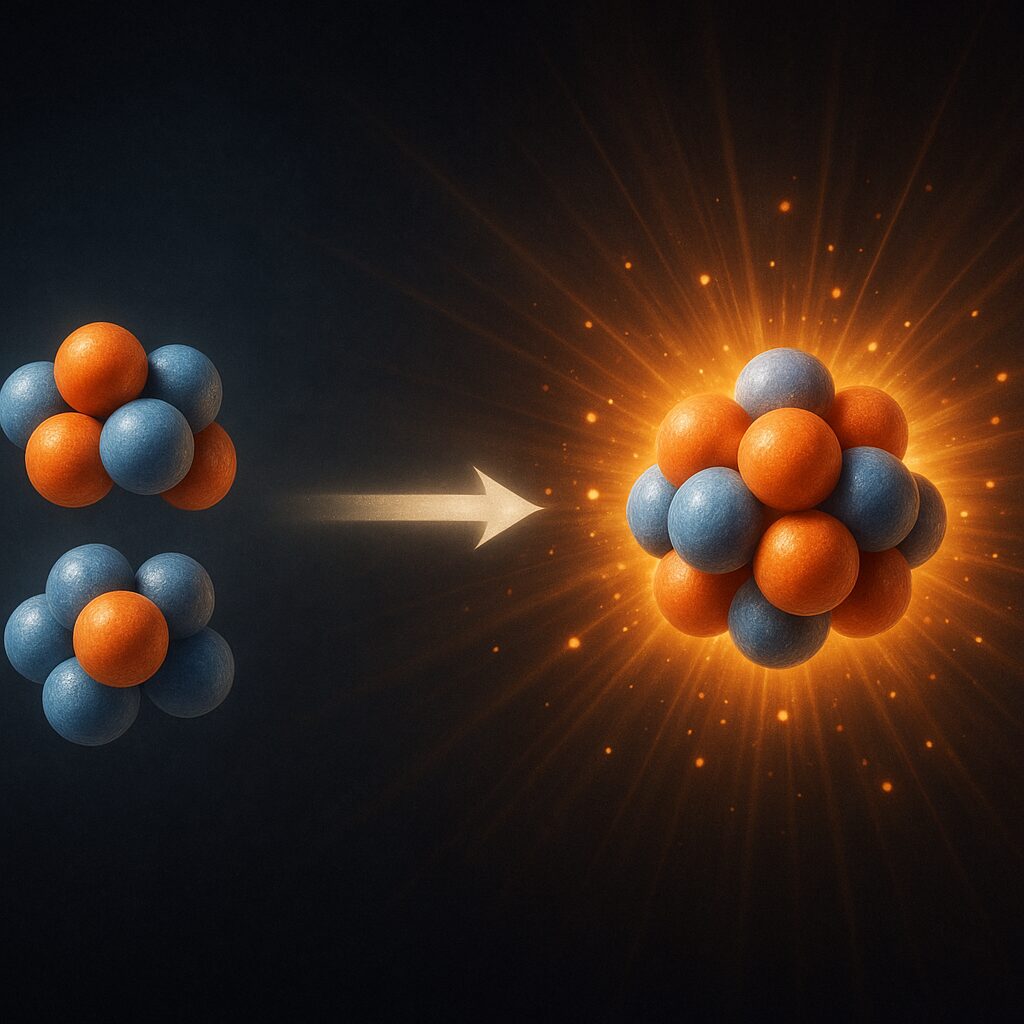

Synteza jądrowa to proces, w którym dwa lekkie jądra atomowe łączą się, tworząc cięższe jądro, czemu towarzyszy uwolnienie dużej ilości energii. Intuicyjnie można ją przeciwstawić rozszczepieniu jądrowemu, gdzie ciężkie jądra, takie jak uran, rozpadają się na lżejsze, też emitując energię. Źródłem obu zjawisk jest energia wiązania jądrowego, czyli miara, jak mocno nukleony (protony i neutrony) są związane w jądrze atomowym.

Wykres energii wiązania na nukleon pokazuje, że dla bardzo lekkich jąder (np. wodoru, helu) i bardzo ciężkich (uran, pluton) można uzyskać energię, przesuwając się w stronę jąder pośrednich, w okolicach żelaza. Lekkie jądra „zyskują”, gdy się połączą, ciężkie – gdy się rozpadną. Dlatego właśnie synteza wodoru w hel w gwiazdach oraz rozszczepienie uranu w reaktorach i bombach jądrowych są procesami energetycznie korzystnymi.

W reakcjach syntezy, które interesują energetykę, kluczową rolę pełnią izotopy wodoru: deuter (D lub ^2H) i tryt (T lub ^3H). Najbardziej obiecująca reakcja to:

D + T → ^4He (jądro helu) + neutron + energia

W wyniku tej reakcji powstaje jądro helu oraz wysokoenergetyczny neutron, a wydzielona energia wynosi około 17,6 MeV na jedno zderzenie. W skali makroskopowej, odniesionej do kilogramów paliwa, jest to energia rzędy miliony razy większa niż w typowych reakcjach chemicznych, np. spalaniu węgla czy gazu.

Problem polega na tym, że dodatnio naładowane protony w jądrach wodoru silnie się odpychają elektrostatycznie. Aby doszło do zlania się jąder, muszą one znaleźć się bardzo blisko, w zasięgu oddziaływania silnego, które działa na odległościach rzędu 10^-15 m i jest w stanie przezwyciężyć odpychanie kulombowskie. W warunkach laboratoryjnych oznacza to konieczność nadania jądrom ogromnych energii kinetycznych, czyli osiągnięcia temperatur rzędu dziesiątek lub setek milionów stopni Celsjusza.

Tak wysokie temperatury prowadzą do powstania plazmy – czwartego stanu materii, w którym elektrony są oderwane od jąder, a gaz staje się w pełni zjonizowany. Plazma jest przewodząca, reaguje silnie na pola magnetyczne, a jej własności opisuje się nie tylko równaniami gazu doskonałego, ale także równaniami elektromagnetyzmu i hydrodynamiki. Zapanowanie nad tak energetycznym i niestabilnym środowiskiem jest jednym z największych wyzwań całej technologii syntezy.

Przy opisywaniu warunków koniecznych do zajścia syntezy w skali makro używa się tzw. kryterium Lawsona. Mówi ono, że aby proces był energetycznie opłacalny, iloczyn gęstości cząstek, temperatury i czasu ich utrzymywania musi przekroczyć pewną wartość graniczną. Różne koncepcje reaktorów – od tokamaków po systemy inercyjne – starają się spełnić to kryterium różnymi kombinacjami tych trzech parametrów.

Synteza jądrowa w gwiazdach i we Wszechświecie

Naturalnym laboratorium syntezy są gwiazdy. Ich wnętrza dostarczają odpowiednich warunków temperatury, ciśnienia i gęstości dzięki olbrzymiej masie i równowadze między grawitacją a ciśnieniem promieniowania. To właśnie tam zachodzi kaskada reakcji, która zamienia prosty wodór w hel, a następnie w cięższe pierwiastki, aż po żelazo i dalej – w wybuchach supernowych.

W gwiazdach o masie podobnej do Słońca dominuje tzw. cykl protonowo-protonowy (pp). Jego pierwszym etapem jest połączenie dwóch protonów, przy czym w jednej z tych cząstek jeden proton zamienia się w neutron (poprzez słabe oddziaływanie), co prowadzi do powstania deuteru. Następnie deuter łączy się z kolejnym protonem, tworząc hel-3, a kolejne reakcje wiodą do powstania stabilnego helu-4. Choć pojedyncze reakcje są mało prawdopodobne, w skali całej gwiazdy liczba zderzeń jest tak ogromna, że efekt energetyczny jest imponujący.

W gwiazdach masywniejszych, o wyższej temperaturze jądra, istotną rolę odgrywa proces CNO (węgiel–azot–tlen), w którym jądra tych pierwiastków pełnią rolę katalizatora. Ich obecność umożliwia inną drogę przekształcania wodoru w hel, wydajniejszą w wyższych temperaturach. Z perspektywy astrofizyki istotne jest, że te procesy są źródłem promieniowania gwiazd i determinują ich ewolucję, długość życia oraz sposób zakończenia – jako białe karły, gwiazdy neutronowe lub czarne dziury.

W późniejszych etapach życia gwiazdy, zwłaszcza tych o większej masie, zachodzą procesy zwane nukleosyntezą gwiazdową. W wyniku kolejnych faz zapłonów w jądrze i powstających powłok konwekcyjnych wodór przekształca się w hel, hel w węgiel i tlen, a następnie te pierwiastki w jeszcze cięższe: neon, magnez, krzem, aż po żelazo. Z każdym etapem rośnie skomplikowanie reakcji i wzrasta temperatura wymagana do utrzymania syntezy. Jednak na żelazie łańcuch ten w zasadzie się zatrzymuje – dalsze tworzenie jeszcze cięższych jąder wymaga dostarczenia energii, zamiast ją wydzielać.

Tymczasem rozkład pierwiastków we Wszechświecie wyraźnie pokazuje obecność wielu pierwiastków cięższych niż żelazo, takich jak złoto, uran czy ołów. Ich powstanie tłumaczy się procesami r- i s- (szybki i wolny wychwyt neutronów), zachodzącymi m.in. w supernowych i zderzeniach gwiazd neutronowych. W tych ekstremalnych środowiskach gęstości neutronów są tak duże, że jądra mogą „połykać” kolejne neutrony, a następnie ulegać rozpadowi beta, co prowadzi do przesunięcia się w górę tablicy pierwiastków.

Wszystkie te procesy – od syntezy wodoru w jądrze młodej gwiazdy, po burzliwe eksplozje supernowych – składają się na kosmologiczną historię materii. Atom żelaza w ludzkiej hemoglobinie mógł powstać w sercu dawno zmarłej gwiazdy, a atomy złota w pierścionku mogły być efektem zderzenia dwóch gwiazd neutronowych. Nauka o syntezie jądrowej nie jest więc jedynie techniczną dziedziną energetyki, ale także kluczem do zrozumienia, skąd wzięły się pierwiastki tworzące życie.

Synteza kontrolowana: od tokamaków do laserów

Przenosząc się z kosmicznej skali do laboratoriów na Ziemi, pytanie brzmi: jak zrealizować syntezę w sposób kontrolowany, tak aby więcej energii uzyskiwać, niż wkładamy w podtrzymanie procesu? Tu pojawiają się główne koncepcje badawcze: magnetyczne utrzymywanie plazmy i inercyjne utrzymywanie plazmy. Każda z nich stara się spełnić kryterium Lawsona inną drogą.

Najbardziej rozwiniętą technologią jest tokamak – urządzenie o kształcie torusa (donuta), w którym silne pola magnetyczne utrzymują gorącą plazmę z dala od ścian. Pole generowane przez zewnętrzne cewki elektromagnetyczne i prąd płynący w samej plazmie tworzą konfigurację, która krępuje ruch naładowanych cząstek wzdłuż tzw. powierzchni magnetycznych. Dzięki temu możliwe jest długotrwałe utrzymywanie plazmy o temperaturze kilkudziesięciu lub kilkuset milionów stopni.

W tokamakach dużą rolę odgrywa parametryzacja plazmy przez tzw. współczynnik bezpieczeństwa q, beta (stosunek ciśnienia plazmy do ciśnienia pola magnetycznego) oraz różne tryby pracy (L-mode, H-mode). Stabilność plazmy ograniczają rozmaite niestabilności magnetohydrodynamiczne, takie jak tryby krawędziowe ELM czy zakłócenia wywołane rezonansami magnetycznymi. Projektanci urządzeń muszą tak dobrać geometrię cewek i profile prądu, aby maksymalnie tłumić te niestabilności, jednocześnie uzyskując wysoką gęstość i temperaturę.

Kulminacją prac nad tokamakami ma być międzynarodowy projekt ITER (International Thermonuclear Experimental Reactor) budowany we Francji. Celem ITER-a jest osiągnięcie dodatniego współczynnika wzmocnienia energii Q, czyli więcej energii z syntezy niż zasilającej plazmę. Choć ITER nie będzie jeszcze komercyjną elektrownią, ma zweryfikować, czy nasze rozumienie fizyki plazmy i technologii materiałowej jest wystarczające do budowy kolejnych demonstratorów – takich jak planowany DEMO – zdolnych do ciągłej produkcji energii elektrycznej.

Alternatywą dla tokamaków są stellaratory – urządzenia o bardziej skomplikowanej geometrii pól magnetycznych, w których prąd w plazmie jest minimalizowany, a kształt pola jest tworzony prawie wyłącznie przez zewnętrzne cewki. To zmniejsza ryzyko pewnych typów niestabilności, ale czyni projektowanie i budowę znacznie trudniejszym. Zaawansowane stellaratory, jak Wendelstein 7-X, mają udowodnić, że taka koncepcja jest zdolna do długotrwałego utrzymywania stabilnej plazmy o parametrach przydatnych dla energetyki.

Drugie podejście do syntezy to tzw. inercyjne utrzymywanie plazmy. Tutaj zamiast „zamykać” plazmę w pułapce magnetycznej, kompresuje się małe kulki paliwa (zwykle deuter-tryt) za pomocą bardzo silnych laserów lub wiązek cząstek. Krótkotrwały, ale ekstremalny impuls energii powoduje gwałtowne ściśnięcie i ogrzanie paliwa, tak że w jego centrum zachodzi synteza, zanim materia zdąży się rozlecieć. Czas utrzymywania jest tu bardzo krótki (nanosekundy), ale za to gęstość paliwa jest ogromna w porównaniu z tokamakami.

Przykładem takiego podejścia jest amerykański ośrodek NIF (National Ignition Facility), w którym zestaw potężnych laserów ogniskuje energię na maleńkiej kapsułce paliwowej. W ostatnich latach NIF ogłosił osiągnięcie tzw. zapłonu – sytuacji, w której energia wyprodukowana w reakcji syntezy w paliwie przekroczyła energię dostarczoną do tego paliwa w impulsie laserowym. Nie oznacza to jednak jeszcze opłacalności komercyjnej, ponieważ całkowita energia elektryczna zużyta na wygenerowanie impulsu laserowego wciąż przewyższa energię uzyskaną w reakcjach.

Wokół obu podejść narosło wiele projektów badawczych, startupów i koncepcji alternatywnych: kompaktowe tokamaki z nadprzewodnikami wysokotemperaturowymi, urządzenia typu sferomak, koncepcje magneto-inercyjne czy układy z wykorzystaniem wiązek jonowych. Pomimo różnorodności, każdy projekt musi rozwiązać te same problemy: ograniczenie strat energii z plazmy, odporność materiałów na intensywne promieniowanie neutronowe, efektywną produkcję i obieg paliwa oraz ekonomiczną opłacalność całego systemu.

Wyzwania technologiczne i naukowe

Skonstruowanie elektrowni syntezy jądrowej nie polega tylko na utrzymaniu gorącej plazmy. Niezwykle trudne okazują się także kwestie materiałowe, inżynieria cieplna, bezpieczeństwo i ekonomia. Reakcja D–T generuje ogromną liczbę wysokoenergetycznych neutronów, które bombardują ściany reaktora, powodując uszkodzenia struktury krystalicznej, aktywację materiałów i zmiany właściwości mechanicznych. Konieczne jest opracowanie stopów metali i powłok, które wytrzymają tysiące godzin pracy w tak skrajnym środowisku.

W okolicy pierwszej ściany reaktora powstaje tzw. strefa płaszcza (blanket), w której energia neutronów jest zamieniana na ciepło, a jednocześnie produkowany jest tryt. Jako że na Ziemi tryt prawie nie występuje naturalnie, reaktor syntezy musi wytwarzać go sam, bombardując litem neutronami. To wymaga precyzyjnego zaprojektowania geometrii i składu płaszcza, tak aby współczynnik produkcji trytu był większy od jedności – w przeciwnym wypadku paliwo szybko by się wyczerpało.

Wyzwania fizyczne obejmują również zrozumienie i kontrolę turbulencji w plazmie, które odpowiadają za transport energii i cząstek na skalach znacznie mniejszych niż rozmiar całego urządzenia. Mimo ogromnych postępów symulacje numeryczne magnetohydrodynamiki i kinetyki plazmy wciąż wymagają superkomputerów, a wyniki eksperymentalne niekiedy zaskakują teoretyków. Właśnie dlatego tokamaki, stellaratory i inne urządzenia działają nie tylko jako prototypy technologiczne, ale przede wszystkim jako laboratoria podstawowej nauki o plazmie.

Do tego dochodzą kwestie bezpieczeństwa i percepcji społecznej. Synteza jądrowa często bywa kojarzona z energią jądrową w ogóle, a więc i z problemem odpadów promieniotwórczych czy katastrof reaktorów rozszczepieniowych. W rzeczywistości parametry procesu syntezy sprawiają, że ryzyko niekontrolowanej reakcji łańcuchowej jest znikome – jeśli cokolwiek w systemie zawiedzie, plazma ulega szybkiemu wychłodzeniu i reakcja wygasa. Produkowane odpady są mniej długowieczne niż w klasycznych elektrowniach jądrowych, choć wciąż wymagają odpowiedzialnego zarządzania.

W tle wszystkich tych problemów stoi również kwestia finansowania i czasu. Projekty takie jak ITER wymagają wielomiliardowych inwestycji i międzynarodowej współpracy trwającej dekady. Dla części opinii publicznej i decydentów politycznych perspektywa pierwszych komercyjnych reaktorów około połowy XXI wieku wydaje się zbyt odległa. Z drugiej strony, przełom w tej dziedzinie mógłby radykalnie zmienić globalny system energetyczny, ograniczając zależność od paliw kopalnych i redukując emisje gazów cieplarnianych.

Synteza jądrowa jest więc nie tylko zagadnieniem z zakresu fizyki wysokich energii czy techniki, ale także polem interdyscyplinarnego dialogu. Łączy w sobie badania podstawowe, zaawansowaną inżynierię, ekonomię energii, politykę międzynarodową i pytania etyczne. To, czy uda się ją uczynić praktycznym źródłem energii na wielką skalę, pozostaje jednym z najważniejszych pytań stojących przed współczesną nauką i technologią.

FAQ – Najczęstsze pytania o syntezę jądrową

Na czym polega różnica między syntezą a rozszczepieniem jądrowym?

Synteza jądrowa polega na łączeniu lekkich jąder (np. izotopów wodoru) w cięższe, czemu towarzyszy uwolnienie energii wynikającej z większej energii wiązania w jądrze produktu. Rozszczepienie jądrowe działa odwrotnie: ciężkie jądro (jak uran) rozpada się na dwa lżejsze fragmenty. Oba procesy korzystają z tej samej zasady – dążenia jąder do konfiguracji o większej energii wiązania na nukleon – ale wymagają innych warunków i generują inne typy odpadów.

Czy synteza jądrowa jest bezpieczna jako źródło energii?

Synteza jest uznawana za potencjalnie bardzo bezpieczne źródło energii, ponieważ nie zachodzi w niej reakcja łańcuchowa jak w reaktorach rozszczepieniowych. Do podtrzymania procesu konieczne są skrajne warunki temperatury i gęstości; ich naruszenie powoduje, że plazma natychmiast się wychładza i reakcja gaśnie. Nie ma tu ryzyka „wybuchu jądrowego” na wzór broni atomowej. Odpady powstają głównie z aktywowanych materiałów konstrukcyjnych i mają znacznie krótszy czas życia niż klasyczne odpady z reaktorów na uran.

Dlaczego tak trudno zbudować działającą elektrownię syntezy?

Największą trudnością jest jednoczesne spełnienie wymogów gęstości, temperatury i czasu utrzymywania plazmy przy akceptowalnych stratach energii. Plazma jest skrajnie gorąca i niestabilna, dlatego trzeba ją zamykać w pułapkach magnetycznych lub gwałtownie ściskać impulsami laserowymi. Dodatkowe problemy stwarza niszczące działanie neutronów na materiały oraz konieczność produkcji trytu. Każdy z tych elementów wymaga lat badań, testów i gigantycznej infrastruktury, co spowalnia postęp w kierunku rozwiązań komercyjnych.

Kiedy realnie można się spodziewać komercyjnych reaktorów syntezy?

Prognozy są niepewne, ale wiele scenariuszy wskazuje, że pierwsze demonstracyjne elektrownie syntezy mogłyby powstać w połowie XXI wieku, jeśli projekty takie jak ITER i DEMO zakończą się sukcesem. Równolegle działające startupy i mniejsze konsorcja obiecują szybsze terminy, jednak ich technologie są mniej sprawdzone. Zanim synteza stanie się znaczącym składnikiem globalnego miksu energetycznego, musi upłynąć co najmniej kilka dekad, potrzebnych na dopracowanie technologii, obniżenie kosztów i zbudowanie infrastruktury.